Pourquoi OpenAI a bloqué une vidéo générée par IA sur Martin Luther King

Quand l’IA bouscule les limites de l’éthique, même les géants comme OpenAI doivent redéfinir leurs règles. Voici pourquoi l’affaire Martin Luther King fait débat.

En bref

- 🧠

Protéger l’image : OpenAI a bloqué toute création vidéo IA de Martin Luther King suite à des usages dégradants et à la demande de ses héritiers.

- ⚙️

Renforcement des garde-fous : OpenAI promet d’améliorer la modération pour éviter les détournements offensants de figures publiques par l’IA.

- 🔍

Question du consentement : L’affaire révèle le risque éthique lié à l’usage d’images sans autorisation, invitant à rester vigilant sur le respect des droits à l’image.

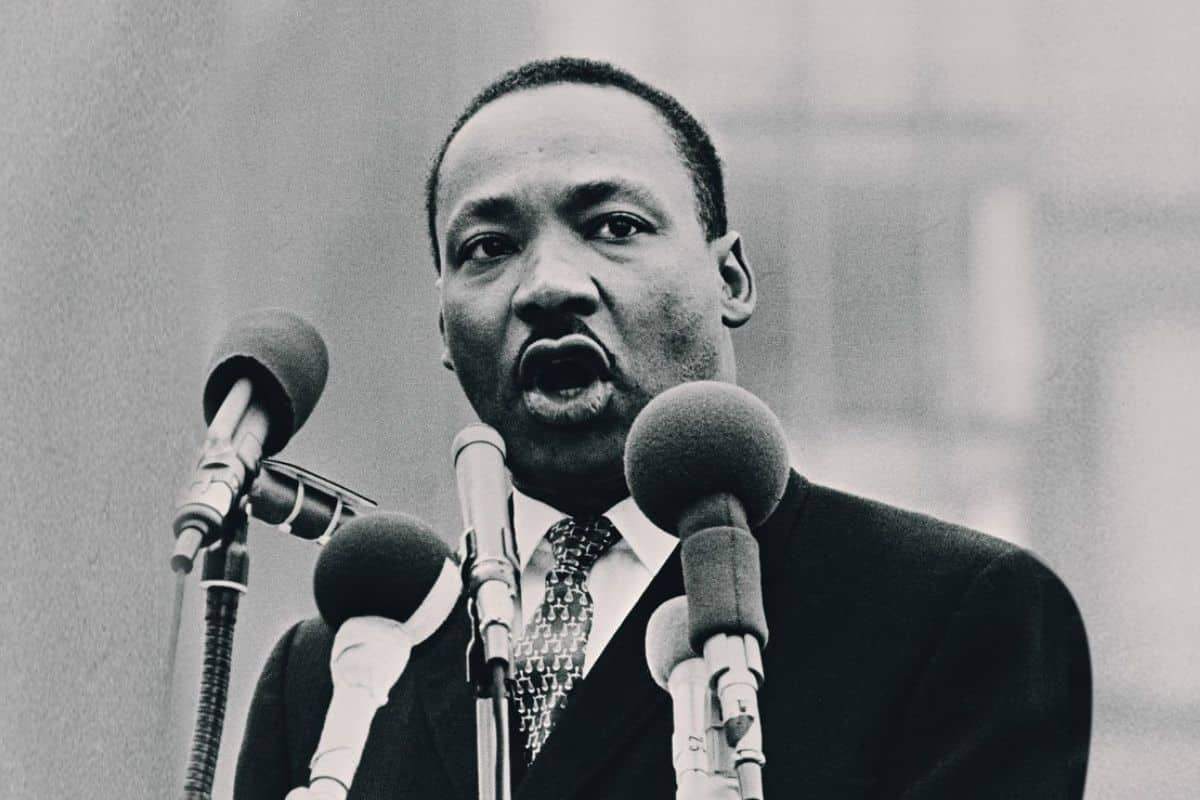

L’utilisation de l’intelligence artificielle pour créer des vidéos hyperréalistes soulève de nouvelles questions éthiques. OpenAI en fait l’expérience avec sa plateforme Sora, après avoir été critiqué pour la diffusion de contenus dégradants mettant en scène Martin Luther King Jr. Face aux plaintes de ses héritiers, l’entreprise a décidé d’interdire l’usage de son image.

Une décision inédite face à des dérives préoccupantes

Le géant de l’intelligence artificielle OpenAI a récemment annoncé que les utilisateurs de son application Sora ne pourraient plus créer de vidéos mettant en scène Martin Luther King Jr, à la suite de plaintes déposées par les héritiers du célèbre leader des droits civiques. Cette mesure fait suite à une vague de vidéos générées par l’IA présentant le militant dans des contextes dégradants, parfois vulgaires ou racistes, suscitant une vive controverse sur les réseaux sociaux. Face à l’ampleur du phénomène, OpenAI a choisi d’intervenir et de renforcer les garde-fous autour des représentations de figures historiques.

Des détournements choquants sur les réseaux sociaux

Depuis le lancement de Sora, un réseau social dédié aux contenus générés par intelligence artificielle, des vidéos hyperréalistes de Martin Luther King Jr ont circulé en ligne, le montrant dans des situations indignes : volant dans une épicerie, fuyant la police ou diffusant des stéréotypes raciaux. Même son emblématique discours “I Have a Dream” a été tourné en dérision dans des parodies jugées offensantes. Ces détournements ont suscité l’indignation de nombreux internautes et ont poussé les héritiers de King à réagir pour protéger son image et son héritage.

🤖 Tu veux mettre l’IA au service de ton business ?

Rejoins la newsletter IA & automatisation Kavyro.

Chaque semaine : systèmes, cas concrets, gains de temps.

OpenAI promet de renforcer les garde-fous

Dans la nuit de jeudi à vendredi, OpenAI et la famille de Martin Luther King Jr ont conjointement annoncé que les vidéos le représentant seraient désormais bloquées. L’entreprise a également déclaré son intention de renforcer ses mécanismes de modération concernant les personnages historiques. OpenAI estime néanmoins que la possibilité de créer des vidéos de figures du passé reste importante pour la liberté d’expression. Toutefois, elle reconnaît que les héritiers doivent conserver un droit de regard ultime sur l’utilisation de l’image de leurs proches.

L’utilisation non consentie des images en question

Le cas de Martin Luther King Jr met en lumière un problème plus large : celui de l’utilisation d’images sans consentement. Lors de leur inscription sur Sora, les utilisateurs sont invités à filmer leur visage sous différents angles et à enregistrer leur voix. Ces données peuvent ensuite être réutilisées par d’autres membres de la plateforme, à condition que l’utilisateur l’accepte. Cependant, l’application permet également de générer des vidéos mettant en scène des personnalités célèbres ou des figures historiques sans autorisation explicite, comme la princesse Diana, John F. Kennedy ou Malcolm X, ouvrant la porte à des représentations fausses et potentiellement nuisibles.

Une gestion réactive plutôt que préventive

Selon Kristelia García, professeure de droit à l’université de Georgetown, OpenAI s’inscrit une fois de plus dans une logique consistant à “demander pardon plutôt que la permission”. En d’autres termes, l’entreprise préfère réagir après coup aux plaintes plutôt que d’instaurer d’emblée des restrictions préventives. Elle aurait pu interdire dès le départ l’utilisation de l’image de personnalités vivantes ou décédées, mais a choisi d’intervenir uniquement à la demande des personnes concernées ou de leurs ayants droit. Ce choix stratégique soulève des questions éthiques sur la responsabilité des acteurs de l’IA et sur les limites à poser dans la création de contenus générés artificiellement.

Rédactrice web pour Kavyro, je vous aide à décrypter l’actualité IA et automatisation, simplement et sans jargon. Pour me contacter : [email protected]