États-Unis : des technologies d’IA pour traquer migrants et étudiants pro-palestiniens aux USA

Quand un algorithme mal réglé décide à votre place, le gain de temps peut vite coûter cher. Comment garder le contrôle sans sacrifier l’efficacité ?

En bref

- ⚙️

Automatisation à risque : un système automatisé mal réglé ou opaque peut générer des erreurs lourdes de conséquences, jusqu’à bloquer ou expulser sur la base de critères flous.

- 🔍

Contrôle humain indispensable : même en automatisant, gardez la main sur vos workflows critiques et documentez-les pour corriger vite en cas de dérive.

- 💼

Automatiser sans perdre la maîtrise : l’IA peut faire gagner du temps, mais votre business reste sécurisé seulement si chaque automatisation reste compréhensible, testée et surveillée.

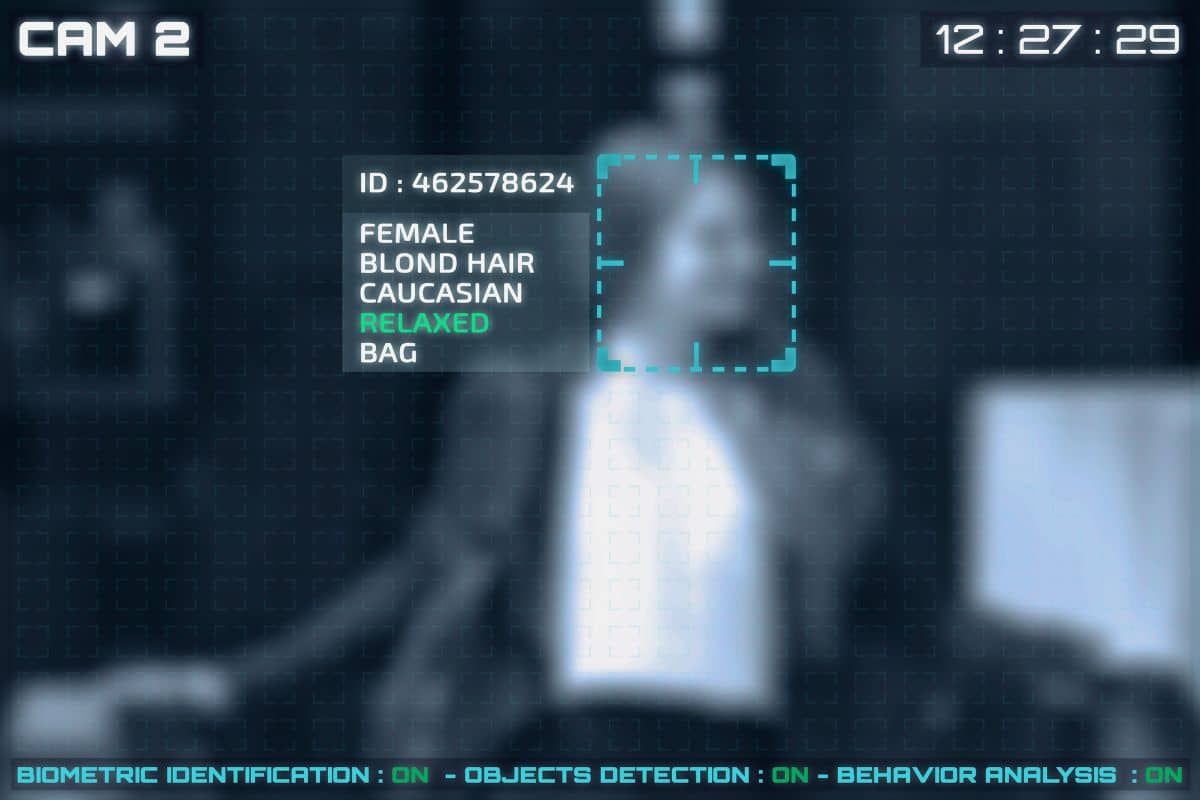

La frontière entre avancée technologique et dérive sécuritaire se fait plus ténue : les autorités américaines recourent désormais à des systèmes d’intelligence artificielle (IA) pour filtrer, surveiller et, parfois, expulser des migrants et étudiants étrangers dont les opinions sur la situation à Gaza sont jugées sensibles. Ce nouvel usage soulève des questions concrètes pour tous ceux qui se fient à l’automatisation pour gagner du temps, et rappelle à quel point un système mal paramétré ou opaque peut vite se transformer en machine à problèmes.

Surveillance algorithmique : comment les outils américains fonctionnent-ils ?

L’administration s’appuie sur des solutions comme Babel X ou Immigration OS pour passer au crible des quantités massives de données publiques — en particulier les publications sur les réseaux sociaux. Un étudiant étranger poste un message de soutien à Gaza ? Un migrant s’indigne du sort des civils ? Leurs propos sont analysés par les algorithmes, qui repèrent automatiquement les « signaux faibles » de ce qu’ils estiment être du militantisme pro-palestinien.

Ici, il ne s’agit pas de modérer ou de bloquer des contenus, mais bien de croiser ces analyses avec le statut administratif de la personne, pour déterminer si sa présence sur le sol américain doit être considérée à risque. L’ensemble se fait sans intervention humaine directe, avec des décisions purement automatisées, qui peuvent conduire à la révocation de visa ou à une procédure d’expulsion.

🤖 Tu veux mettre l’IA au service de ton business ?

Rejoins la newsletter IA & automatisation Kavyro.

Chaque semaine : systèmes, cas concrets, gains de temps.

Le risque : partialité et effets de bord concrets

Ce qui inquiète les observateurs indépendants, c’est la précarité juridique et l’arbitraire algorithmique : ces outils, aussi puissants soient-ils, restent faillibles. L’analyse de texte ne permet pas toujours de distinguer solidarité humanitaire et incitation à la haine, d’où des décisions qui tombent sur la base de simples opinions, décontextualisées.

Pour un entrepreneur, ce cas souligne les pièges potentiels de toute automatisation mal pilotée : un workflow sans supervision, et c’est la porte ouverte aux erreurs à grande échelle. Le parallèle est vite fait avec l’automatisation des factures, des relances ou des emails clients : laisser tourner un scénario mal réglé, c’est s’exposer à des sanctions, voire à la casse opérationnelle.

Que retenir pour sécuriser ses systèmes d’automatisation ?

- Gardez la main sur vos flux critiques : même si l’automatisation libère du temps, prévoyez toujours un contrôle humain aux étapes sensibles, surtout pour les décisions qui peuvent impacter vos revenus ou la relation client.

- Privilégiez la clarté sur les critères de déclenchement des scénarios : une règle floue, et vous multipliez le risque de mauvaises surprises.

- Documentez chaque automatisation, même simple, pour corriger vite en cas de dérive.

- Posez la question du biais : vos outils peuvent-ils interpréter un comportement à tort ? Testez, faites-vous relire, vérifiez les exceptions et les cas limites.

Pourquoi l’actualité américaine interpelle tous les professionnels qui automatisent

Au-delà de la surveillance migratoire, ce dossier américain met en lumière la nécessité d’un usage responsable de l’IA : ce qui paraît simple en théorie (gain de temps, filtrage automatique, délégation), devient un casse-tête dès que l’algorithme dérape. Pour ceux qui cherchent à libérer +10h/semaine grâce à l’automatisation, la leçon est claire : aucune technologie ne dispense de vigilance ni de points de contrôle. Une automatisation efficace, c’est celle qui fait gagner du temps sans faire perdre la maîtrise.

Pour aller plus loin

- Rapport Amnesty : IA et surveillance des migrants aux États-Unis

- Enquête Mediapart sur le dispositif algorithmique

Rédactrice web pour Kavyro, je vous aide à décrypter l’actualité IA et automatisation, simplement et sans jargon. Pour me contacter : [email protected]